当サイトは、アフィリエイトプログラムによる収益を得ています。

こんにちは、よたろです。

生成系AIの話題を最近、いろんなところで聞くようになりましたね。

動画を生成するAIもRunwayから発表された、Gen1やGen2が話題になりました。

Gen2は、テキストから新しい映像を生成できてしまいます。

いよいよ映像もAIが作れる時代になってきました。

そんな中で、「Zeroscope」というオープンソースの動画生成AIがあるぞ、と話題になっていることを見つけたので紹介させてください。

ZeroScopeについて

Zeroscopeは、無料で使える、オープンソースのようです。

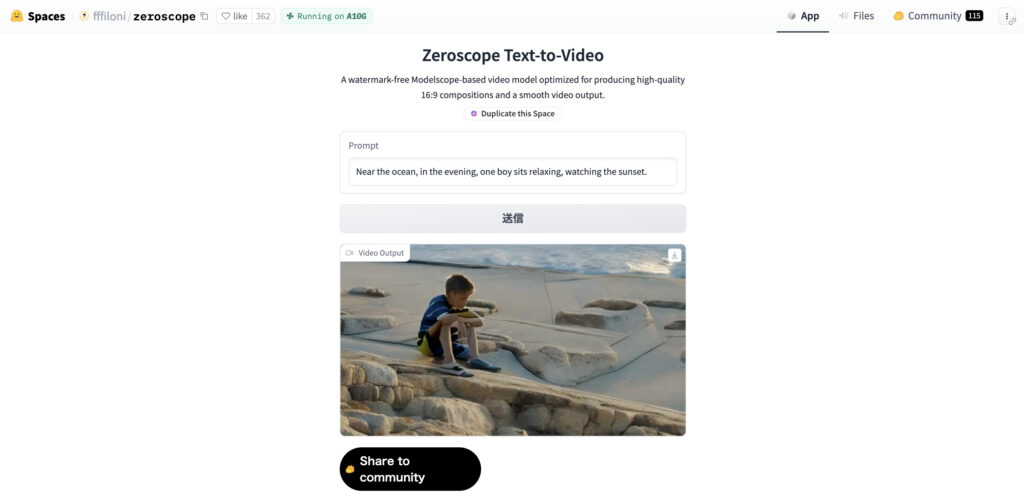

こちらのページで実際に映像を作ることが試せるみたいです。

ちなみに、上記のサイト、なんかアイコン的に怪しそうなサイトですが、そうでもありません。

Hugging Faceという、AIや機械学習系に特化した実行環境やコードを共有しておくようなサービスみたいです。

詳しくはわかりませんが、AmazonやGoogleもこのサービス使ってるみたいなので、安心して利用して良いでしょう。

さて、Zeroscopeに話を戻します。

Zeroscopeには、 いくつかのモデルがありようです。

今回は、Zeroscope_v2 567wというデフォルトのモデルを使ってみます。

576 × 320 ピクセルの解像度で、素早く生成したい時に活用されるモデルを使ってみます。

これ以外にも、より解像度の高い映像を作るモデルもあるみたいです。

実際に使ってみる

今回は、567wの方を利用してみます。

使い方は簡単で、テキストを入力するだけ。

あとは送信ボタンを押して待つことで、動画がつくられます。

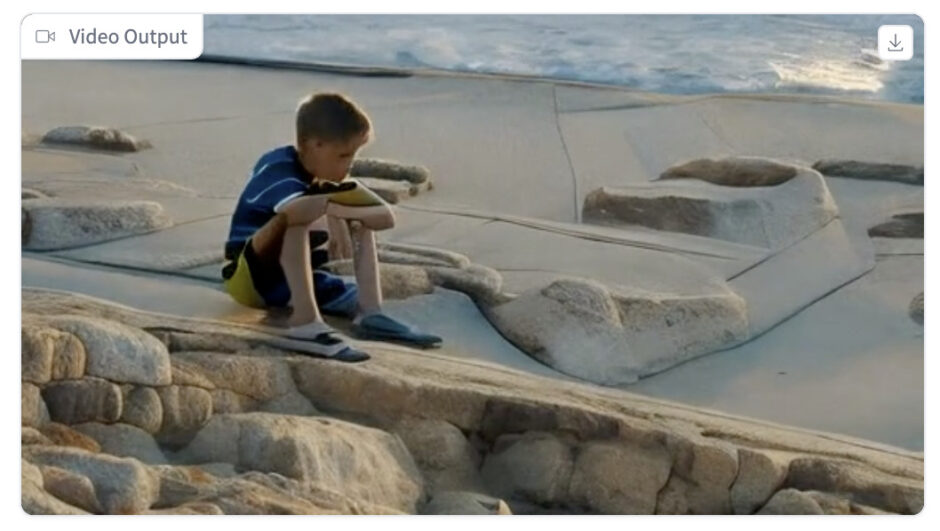

今回は、試しに、「海の近くで、夕方に、夕焼けを見ながらリラックスして座っている少年が一人いるシーン」を、英語に直して、映像を作ってみます。

Near the ocean, in the evening, one boy sits relaxing, watching the sunset.映像が作られるまで、5分ほどかかりましたが、3秒の映像が出来上がりました。

正直、テキストだけでこれだけの高画質な映像を作れるのは、とても驚きました。

Runwayが公開しているGen-1で作られた動画と、同等のクオリティの高さを感じます。

入力が、テキストだけなので、雑な絵が出来上がるんだろうか、と思っていましたが、まあまあのクオリティで驚きました。

これが、無料で公開されているのは、すごいです。。。

おわりに

今回は、動画生成AIのオープンソースとして無料公開されている「ZeroScope」を紹介させていただきました。

RunwayのGen1などを触った感覚からすると、「ZeroScope」もGen-1同様に、かなり高画質な映像が作れている印象です。

これから、動画生成AIのデファクトスタンダードになるのは、一体どれになるのか、今後も注目してみていきたいですね!

ではまた!